Introduction : l’ère du Big Data et de l’IA

Gartner prévoit qu’en 2028, 50 % des décisions pourraient être automatisées ou augmentées par des agents d’IA

Le volume de données produit dans le monde connaît une croissance vertigineuse (163 zettaoctets d’ici 2025 selon IDC). Parallèlement, les entreprises accélèrent l’adoption de l’intelligence artificielle pour guider leurs décisions – Gartner prévoit qu’en 2028, 50 % des décisions pourraient être automatisées ou augmentées par des agents d’IA. Face à cette double révolution data et IA, les organisations doivent repenser leurs fondations technologiques. C’est tout l’enjeu d’une architecture data moderne : une plateforme unifiée capable d’ingérer de massives quantités de données variées, d’en garantir la qualité et la gouvernance, puis de les exploiter pour générer des insights et alimenter des modèles d’IA.

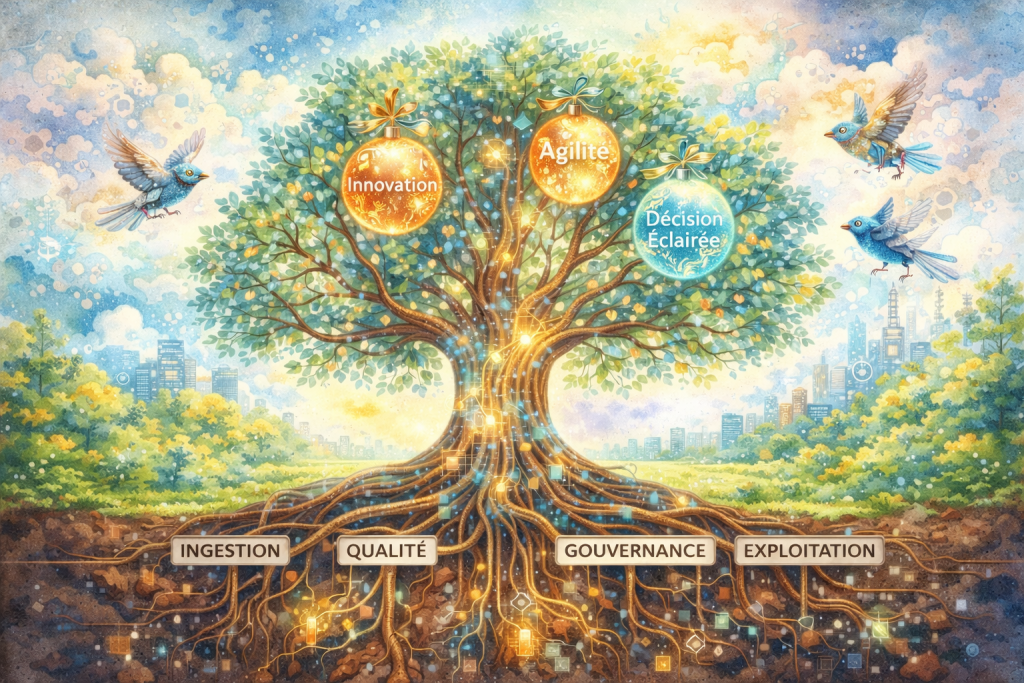

Dans cet article, nous explorons les quatre piliers d’une telle architecture – ingestion, qualité, gouvernance et exploitation des données – en montrant comment l’IA s’y intègre à chaque étape. L’objectif : guider les décideurs IT dans la construction d’une infrastructure data future-proof, alliant innovation et maîtrise.

Ingestion des données : des pipelines robustes et en temps réel

Le premier défi d’une architecture data moderne consiste à ingérer des données provenant d’une multitude de sources (bases de données internes, applications SaaS, capteurs IoT, flux web, etc.), avec des formats et des vitesses variés. Les approches traditionnelles d’ETL par lots ont montré leurs limites face à l’ère du temps réel. Désormais, il s’agit de mettre en place des pipelines de données agiles, capables de collecter et transférer en continu des données brutes vers les plateformes de stockage et de traitement appropriées.

Une architecture d’ingestion moderne s’appuie sur plusieurs ingrédients : des connecteurs polyvalents (SQL, NoSQL, API…), des outils d’intégration automatisés (ETL/ELT dans le cloud) et des technologies de streaming pour les données en flux continu (par exemple Kafka ou Amazon Kinesis). Le tout orchestré de manière sécurisée et scalable afin que chaque nouvelle source de données puisse être ajoutée sans effort excessif. L’IA intervient d’ores et déjà pour optimiser cette couche : surveillance intelligente des flux, détection automatique des schémas de données, ou ajustement dynamique de la capacité en cas de pic de charge. En pratique, cela permet d’absorber un volume et une vélocité de données inédits tout en minimisant les latences.

Exemple réel. Un groupe de restauration a récemment modernisé sa plateforme data pour suivre le boom des commandes en ligne. En adoptant une architecture type « médaille » (bronze-argent-or) sur Microsoft Fabric, il a mis en place des pipelines d’ingestion automatisés intégrant en temps réel les données de caisse et de commandes web. Résultat : les tableaux de bord affichent chaque nouvelle commande en quelques secondes, offrant une visibilité instantanée sur les tendances d’achats et la performance des livraisons. De même, l’agence marketing Tinuiti a déployé un lac de données centralisé pour unifier plus de 100 sources marketing. Grâce à des connecteurs prêts à l’emploi, Tinuiti a accéléré l’onboarding des données clients par 120 – réduisant le délai de 2–4 semaines à moins d’une heure – et automatisé 80 % des flux d’ingestion, libérant ses ingénieurs pour des tâches à plus haute valeur ajoutée. Ces exemples illustrent l’importance de pipelines robustes : toutes les données pertinentes doivent pouvoir affluer rapidement dans l’entreprise, condition sine qua non pour la suite du cycle de vie des données.

Qualité des données : le socle de confiance (amélioré par l’IA)

En moyenne, la mauvaise qualité des données ferait perdre 12,9 millions de dollars par an aux organisations (estimation Gartner)

Une fois les données collectées, encore faut-il qu’elles soient fiables. L’adage “garbage in, garbage out” rappelle qu’aucune analyse ni algorithme d’IA ne peut produire de la valeur à partir de données corrompues. Pourtant, la qualité des données demeure un défi majeur : formats incohérents d’une source à l’autre, valeurs manquantes, doublons, informations obsolètes ou erronées – autant de problèmes courants qui, non traités, induisent des erreurs coûteuses. En moyenne, la mauvaise qualité des données ferait perdre 12,9 millions de dollars par an aux organisations (estimation Gartner). Et ce chiffre ne reflète qu’une partie du coût réel, lorsqu’on pense aux occasions manquées, aux décisions stratégiques biaisées ou à la méfiance que des données douteuses peuvent installer chez les collaborateurs et clients.

L’IA à la rescousse. La bonne nouvelle, c’est que l’intelligence artificielle apporte des solutions inédites pour améliorer la qualité des données de façon proactive. Alors que les approches classiques de gouvernance reposaient sur des règles figées et des corrections manuelles a posteriori, on dispose désormais d’outils d’auto-contrôle “intelligents” :

- Détection d’anomalies : des algorithmes de machine learning passent au crible les ensembles de données pour repérer des valeurs aberrantes ou incohérentes. Par exemple, des banques entraînent des modèles d’Isolation Forest ou d’autoencodeurs à signaler en temps réel des transactions hors norme, indicatrices d’une erreur de saisie ou d’une fraude potentielle.

- Complétion intelligente : plutôt que de laisser des champs vides, des techniques d’imputation prédisent les valeurs manquantes en s’appuyant sur les données existantes. Ainsi dans la santé, des réseaux de neurones peuvent estimer un paramètre clinique manquant à partir des historiques patients comparables.

- Déduplication par apprentissage : le machine learning, combiné au traitement du langage naturel, identifie les enregistrements en double même s’ils ne sont pas strictement identiques (fuzzy matching). Par exemple, il peut reconnaître que “Jean Dupont” et “J. Duponte” sont une seule et même personne en se basant sur des similarités phonétiques et contextuelles.

- Standardisation automatisée : des IA formatent les données de manière uniforme (dates, unités, codes pays…) et peuvent même structurer des textes non structurés en catégories analytiques. Cela réduit drastiquement les erreurs dues à des formats divergents.

« La qualité des données s’impose comme l’un des premiers cas d’usage prometteurs de l’IA générative, et un passage obligé en début de parcours IA », souligne Deloitte dans une analyse récente.

En effet, les modèles d’IA – notamment les large language models – peuvent servir à contrôler et enrichir les données elles-mêmes. Par exemple, un LLM va détecter des libellés produits aberrants dans un catalogue e-commerce ou extraire des attributs manquants d’une description produit pour compléter la fiche. On le voit, investir dans la qualité (data profiling, nettoyage, observabilité des données…) n’est plus qu’une contrainte réglementaire : c’est devenu un facteur stratégique. Les leaders l’ont compris, traitant le data quality non pas comme un chantier ponctuel, mais comme un processus continu – piloté par des outils de Data Quality augmentée par l’IA – afin de fournir aux décideurs et aux algorithmes des données dignes de confiance en permanence.

Gouvernance des données : piloter l’éthique, la conformité et la valeur

Gérer les données à grande échelle requiert un cadre clair. C’est le rôle de la gouvernance des données : définir qui peut faire quoi avec quelles données, dans quelles conditions. Une architecture data moderne s’accompagne nécessairement de politiques de gouvernance pour assurer la disponibilité, l’intégrité, la confidentialité et la traçabilité des données de l’entreprise. Cela englobe les règles d’accès (sécurité, droits selon les rôles), la conformité réglementaire (respect du RGPD et autres lois de protection des données), la qualité (définir des owners et stewards garants de la fiabilité) et la gestion du cycle de vie des données. Bref, la gouvernance vise à transformer un amas de données brutes en un patrimoine informationnel organisé, compréhensible et exploitable par tous avec confiance.

Dans la pratique, la gouvernance est intimement liée à la gestion des métadonnées (metadata management). Il s’agit de capturer et centraliser toutes les informations décrivant les données : leur source, leur signification métier, les transformations subies, les utilisateurs qui y ont accédé, etc. Un catalogue de données moderne, alimenté par ces métadonnées, agit comme un véritable GPS du patrimoine data : on y trouve la « fiche d’identité » de chaque dataset, son niveau de qualité, son responsable, et même les dépendances entre jeux de données. Les organisations data-driven investissent dans ces solutions (Collibra, Alation, Atlan…) pour instaurer un langage commun autour de la donnée et éviter les silos. L’IA permet désormais d’aller plus loin avec le concept de métadonnées actives : plutôt qu’un simple annuaire, la plateforme de métadonnées utilise le machine learning pour détecter des anomalies (par ex. un dataset qui ne s’est pas mis à jour comme prévu), suggérer des jeux de données pertinents aux analystes ou générer automatiquement de la documentation. En rendant les métadonnées vivantes, on améliore la réactivité aux problèmes et on alimente un cercle vertueux de connaissance partagée.

IA et gouvernance, même combat. Il ne suffit pas de gérer la data pour l’IA : l’IA elle-même peut aider à mieux gouverner la data. Par exemple, des algorithmes de classification automatiques identifient et étiquettent des données sensibles (PII) au sein des lacs de données, déclenchant des règles de protection appropriées. De plus, l’IA peut surveiller les usages de la donnée et repérer des accès atypiques ou non conformes en temps réel (une forme de « compliance automatisée »). À l’inverse, l’essor d’IA générative amène de nouveaux enjeux de gouvernance : il faut contrôler quelles données d’entreprise sont fournies à ces modèles et comment en encadrer les résultats. Là encore, la gestion fine des métadonnées est clé. Un exemple concret : la plateforme Komprise permet d’appliquer des filtres métadonnées pour sélectionner quels fichiers seront transmis à un modèle de langage tel que Nvidia NeMo, garantissant ainsi une gouvernance des données stricte sur les informations utilisées pour entraîner l’IA. Autrement dit, on peut automatiquement écarter les données confidentielles ou non pertinentes du périmètre d’entraînement d’un modèle, prévenant les fuites ou les biais avant même qu’ils ne surviennent.

Enfin, une gouvernance bien pensée apporte aussi de la valeur business. En centralisant les définitions et règles, on assure une consistance des indicateurs à travers l’organisation (tout le monde parle le même langage data). On facilite la conformité réglementaire en étant capable de répondre rapidement aux questions « d’où vient cette donnée ? » ou « qui y a eu accès ? ». On améliore l’efficacité opérationnelle en évitant les redondances et en fiabilisant les flux (moins de temps perdu à recouper des chiffres divergents). Surtout, on jette les bases d’une monétisation ou d’une valorisation accrue des données : une entreprise qui connaît parfaitement ses données et les gouverne bien peut les réutiliser pour développer de nouveaux services, générer des revenus additionnels ou nouer des partenariats en confiance. En somme, gouvernance et métadonnées forment un duo inséparable pour transformer la data en actif stratégique, exploitable en toute confiance.

Exploitation : de la Business Intelligence à l’IA opérationnelle

Une architecture data moderne n’a de sens que si elle permet d’exploiter pleinement les données afin de créer de la valeur. Après l’ingestion, le nettoyage et la gouvernance, vient l’heure de mettre les données au service de la décision et de l’action. Concrètement, cela recouvre plusieurs niveaux d’usage : de la BI classique (rapports, tableaux de bord descriptifs) jusqu’aux applications d’IA avancée (modèles prédictifs, analyses prescriptives, voire agents conversationnels alimentés par les données de l’entreprise).

Dans un premier temps, la modernisation de l’architecture data vise souvent à améliorer le reporting et l’accès à l’information pour les équipes métiers. Par exemple, en adoptant un entrepôt de données cloud ou un data lakehouse, on permet aux analystes de croiser rapidement de larges volumes de données historiques et d’obtenir des insights autrefois impossibles. Les tableaux de bord deviennent plus dynamiques, mis à jour en quasi temps réel grâce aux flux d’ingestion continue – ce qui aide les managers à piloter l’activité comme on regarde le trafic routier sur Waze. Le cas du restaurant cité plus haut en est l’illustration : ses dashboards Power BI affichent instantanément les commandes digitales et n’accusent plus que 0,00002 % d’écart par rapport à la réalité des ventes, un niveau de précision jamais atteint avant la refonte de l’architecture.

Au-delà de la BI, l’enjeu est de passer de l’analytique à l’opérationnel. Cela signifie intégrer des modèles de Machine Learning et d’IA directement dans les processus métiers pour automatiser des décisions ou personnaliser des actions en temps réel. Pour y parvenir, les organisations mettent en place des plateformes de MLOps – un ensemble de pratiques et d’outils qui unifient le développement et le déploiement des modèles ML, à l’image du DevOps pour le logiciel. Le MLOps (Machine Learning Operations) permet d’industrialiser la chaîne de valeur de l’IA : préparation des données d’entraînement, entraînement sur des environnements distribués, déploiement continu des modèles en production, surveillance de leurs performances et réentraînement périodique. En adoptant une approche MLOps, les entreprises peuvent passer plus rapidement du prototype d’IA à une solution fiable à l’échelle, tout en évitant l’« effet labo » (modèles qui fonctionnent en sandbox mais pas dans le monde réel).

Exemples concrets. Dans l’industrie, des algorithmes prédictifs exploitent les données de capteurs pour anticiper les pannes d’équipements (maintenance prédictive), évitant des arrêts coûteux. Dans la distribution, des moteurs de recommandation combinent historique d’achats et données contextuelles pour personnaliser l’expérience client en temps réel (suggestions produits, offres next best action). Toutes ces applications reposent sur une architecture capable de servir des données fraîches aux modèles d’IA et de récupérer leurs résultats pour les intégrer aux systèmes opérationnels (site e-commerce, CRM, outil logistique, etc.). La réussite de ces projets tient beaucoup à la collaboration entre équipes data, développeurs et métiers, soutenue par une architecture robuste.

La trajectoire de Tinuiti en est une parfaite illustration. En modernisant son infrastructure data, cette agence marketing a pu bâtir un produit analytique innovant (« Bliss Point ») fournissant des insights marketing ultra-précis via des modèles de causalité et de machine learning. Les bénéfices ont été immédiats : délai de mise à disposition des données drastiquement réduit, élimination des tâches manuelles fastidieuses et focalisation des talents sur l’innovation. « Cette transformation a complètement bouleversé nos opérations data… Désormais, nos équipes peuvent se concentrer sur du travail à forte valeur ajoutée, comme notre nouveau data lake qui alimente des insights dopés à l’IA pour nos clients », témoigne Lakshmi Ramesh, VP Data Services chez Tinuiti. En d’autres termes, une architecture data moderne libère le potentiel créatif des équipes en automatisant la plomberie data. Lorsque l’ingestion est fiable, que les données sont propres et bien gouvernées, les data scientists et analystes peuvent s’atteler à ce qui compte vraiment : expérimenter des modèles, extraire des corrélations cachées, inventer de nouveaux services pilotés par la data. C’est ainsi que les entreprises data-driven transforment un actif dormant (leurs gisements de données) en avantage compétitif concret.

Conclusion : vers un avantage stratégique durable

En synthèse, adopter une architecture data moderne avec IA revient à maîtriser de bout en bout le cycle de vie de la donnée – de son ingestion multiformat à son exploitation intelligente – pour en tirer des bénéfices tangibles. Les organisations qui excellent sur ces quatre piliers (ingestion, qualité, gouvernance, exploitation) récoltent d’ores et déjà les fruits d’une décision plus éclairée, d’une agilité accrue et d’une innovation accélérée. À l’inverse, celles qui tardent à moderniser leur architecture s’exposent à un coût d’opportunité énorme : données inexploitées, initiatives d’IA avortées faute de base solide, et au final un retard compétitif difficile à rattraper.

Enjeux stratégiques clés :

- Holisme de la plateforme. Les entreprises doivent penser l’architecture data de façon globale et intégrée. Par exemple, un pipeline d’ingestion en temps réel n’a de sens que si les mécanismes de contrôle qualité suivent derrière pour valider les données en flux. De même, lancer des pilotes d’IA spectaculaires est vain sans une gouvernance garantissant la fiabilité et l’éthique des données utilisées. Chaque brique renforce les autres, il est crucial de viser la cohérence d’ensemble.

- Culture data et leadership. La technologie seule ne suffit pas. Mettre en place une architecture moderne doit s’accompagner d’une évolution culturelle : sensibilisation des équipes à l’importance de la qualité des données, formation aux nouveaux outils (catalogues, dashboards, notebooks ML…), et soutien visible du top management. De plus en plus d’entreprises nomment d’ailleurs des Chief Data Officers ou créent des Data Offices pour piloter cette transformation transverse.

- Innovation continue. L’écosystème data/IA évolue vite (nouveaux outils, nouvelles meilleures pratiques, réglementations émergentes autour de l’IA, etc.). Bâtir une architecture moderne n’est pas un projet figé mais un processus continu d’amélioration. Il faut adopter une posture agile, avec des architectures modulaires prêtes à intégrer les avancées (ex: ajouter un outil de Data Observability alimenté par IA, connecter une nouvelle plateforme de deep learning, migrer vers un data lakehouse plus performant…). Cette capacité d’adaptation sera un facteur décisif de durabilité.

En définitive, investir dans une architecture data moderne avec IA revient à bâtir les fondations de l’entreprise de demain : une entreprise guidée par la donnée, capable d’apprendre et de s’ajuster en permanence. Les décideurs IT ont tout intérêt à s’informer en continu sur ces évolutions (s’abonner à une veille spécialisée, par exemple) et à s’entourer d’experts pour les accompagner dans cette démarche. Car une fois ces fondations en place, les perspectives sont immenses – de la démocratisation de l’analytique à l’intelligence artificielle omniprésente – et elles dessinent un avantage compétitif durable à l’ère de l’IA.

Contactez-nous pour plus d’information.