Pourquoi l’optimisation des coûts cloud est cruciale

Gartner estimait même que 60 % des équipes IT subiraient des dépassements de budget cloud impactant négativement leurs finances internes jusqu’en 2024

Les entreprises migrent massivement vers le cloud, et les dépenses associées explosent. Les analystes prévoient plus de 700 milliards de dollars dépensés en services cloud publics en 2025. Or, une part importante de ce budget est gaspillée : selon Flexera, environ 28 à 32 % des dépenses cloud sont inutilisées – des ressources payées mais non exploitées pleinement. Conséquence, plus de la moitié des organisations constatent que leurs coûts cloud dépassent les prévisions budgétaires. Gartner estimait même que 60 % des équipes IT subiraient des dépassements de budget cloud impactant négativement leurs finances internes jusqu’en 2024. Cette situation a placé l’optimisation des coûts cloud au rang de priorité stratégique : il s’agit non seulement de réduire la facture, mais aussi d’aligner les dépenses cloud sur la valeur business.

Cette optimisation est d’autant plus cruciale qu’un manque de contrôle peut avoir de graves conséquences financières. « Le cloud a retiré la finance du processus d’achat et mis la carte de crédit entre les mains des ingénieurs », note J.R. Storment de la FinOps Foundation, soulignant le risque d’une dérape incontrôlée des dépenses sans garde-fous. En d’autres termes, sans visibilité ni gouvernance, l’agilité offerte par le cloud peut se transformer en « train lancé à pleine vitesse » difficile à arrêter. Des études révèlent que le gaspillage cloud provient d’abord de ce manque de visibilité : dans 54 % des cas, les dépenses inutiles s’expliquent par une absence de suivi et de transparence. Face à ces enjeux, maîtriser les coûts cloud est devenu indispensable pour protéger la marge de l’entreprise tout en continuant d’innover. C’est là qu’interviennent les bonnes pratiques d’optimisation et les approches FinOps que nous aborderons plus loin.

Comprendre vos dépenses AWS et Azure

Globalement, on estime qu’il existe aujourd’hui plus de 4 millions de points de prix cloud chez AWS et Azure, contre à peine 10 000 il y a une décennie

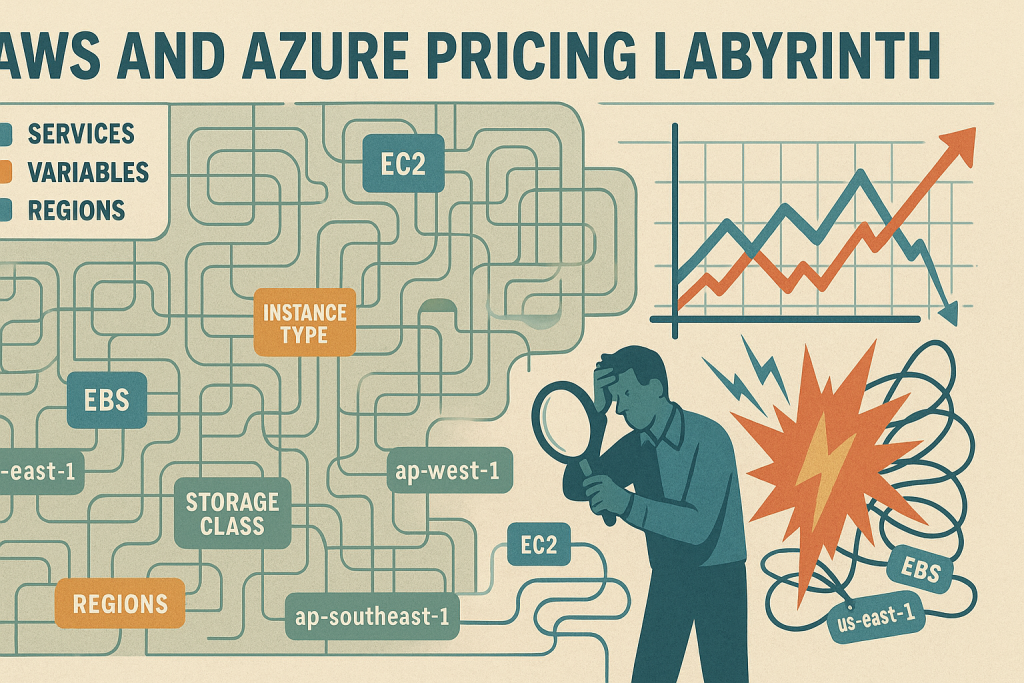

Avant de pouvoir optimiser, il faut comprendre d’où viennent les coûts cloud sur AWS et Azure. La facturation cloud est notoirement complexe : chaque fournisseur propose des centaines de services aux modèles tarifaires variés (calcul, stockage, bases de données, transfert réseau, etc.), facturés à l’usage avec de multiples variables. Le résultat ? Une explosion combinatoire des tarifs. Par exemple, pour un simple serveur EC2 sur AWS, on peut choisir parmi 5 familles d’instances, 438 types, ~16 systèmes d’exploitation, ~26 régions, et divers modes d’achat (à la demande, engagement 1 ou 3 ans, spot…) – soit plus d’un million de prix possibles rien que pour cette configuration. Globalement, on estime qu’il existe aujourd’hui plus de 4 millions de points de prix cloud chez AWS et Azure, contre à peine 10 000 il y a une décennie. Cette complexité rend le déchiffrage des factures très ardu et explique le fréquent « bill shock » (facture surprise salée en fin de mois).

Les principaux postes de dépenses cloud se répartissent généralement comme suit : la puissance de calcul (VM, conteneurs, fonctions) constitue la part la plus élevée, suivie par le stockage des données (volumes disques, bases de données, sauvegardes), puis le trafic réseau sortant (les transferts de données hors du cloud, facturés cher au-delà d’un certain volume). S’y ajoutent les licences logicielles intégrées (p. ex. Windows Server ou SQL Server sur Azure, qui gonflent le coût des VM) et divers services managés. Comprendre cette répartition aide à cibler où agir en priorité. Par exemple, un pic de coûts peut venir d’instances surdimensionnées tournant 24/7 à faible utilisation, ou de volumes de stockage oubliés contenant d’anciennes données.

Le manque de visibilité est l’ennemi numéro 1. Sans un suivi granulaire, il est difficile d’attribuer les dépenses à des équipes ou projets, et donc de responsabiliser les acteurs. Il est vivement recommandé de mettre en place une stratégie de tags (étiquetage) systématique de vos ressources AWS/Azure (par application, équipe, environnement…) afin de tracer qui consomme quoi. Des études confirment que lorsque les coûts ne sont pas correctement alloués, seuls 13 % des entreprises parviennent à identifier précisément l’usage de 75 % de leurs dépenses cloud – la plupart naviguent à vue. AWS et Azure fournissent des Cost Explorer et rapports d’usage détaillés : exploitez-les pour repérer les ressources sous-utilisées, les tendances anormales et les plus gros cost drivers. Enfin, gardez à l’esprit que chaque architecture impacte la facture : deux équipes peuvent déployer une application similaire sur le cloud et obtenir des coûts très différents selon qu’elles optimisent (ou non) la mise en veille des ressources, le choix des régions, la compression des données, etc. En somme, bien comprendre vos dépenses AWS/Azure, c’est établir les bases d’une optimisation efficace.

Stratégies d’optimisation des coûts sur AWS

Sur Amazon Web Services, réduire la facture nécessite une approche méthodique combinant bonnes pratiques techniques et utilisation avisée des options tarifaires. Première étape : analyser et surveiller vos usages. Exploitez AWS Cost Explorer pour identifier les services les plus coûteux et suivre l’évolution quotidienne des dépenses. Mettez en place des alertes de budget avec AWS Budgets afin d’être prévenu en cas de dérive (dépassement ou tendance anormale). Par exemple, AWS propose un outil d’anomaly detection qui alerte sur une hausse soudaine de coûts – un filet de sécurité indispensable pour éviter les mauvaises surprises. (On se souvient du cas d’une équipe Adobe ayant laissé par erreur un job tourner sur Azure : la tâche coûtait 80 000 $ par jour et a engendré plus d’un demi-million de dollars avant d’être stoppée – un simple seuil d’alerte aurait pu éviter ce dérapage.) En parallèle, segmentez vos dépenses par tags/projets pour traquer les éventuels « shadow IT » (ressources non officielles).

1. Droitsizing des instances et services : AWS offre une myriade de tailles d’instances EC2, de types de stockage et d’options de base de données. Il est crucial d’adapter chaque ressource à la juste taille. Analysez les métriques CloudWatch : si un serveur tourne à 5 % de CPU la nuit, envisagez une instance plus petite ou de l’éteindre hors des heures de bureau. De même, supprimez ou consolidez les volumes EBS inutilisés. Une pratique courante est de nettoyer les snapshots orphelins : terminer une instance n’élimine pas ses sauvegardes EBS, qui continuent d’occasionner des frais. La mise en place de règles de cycle de vie (Data Lifecycle Manager) permet d’archiver ou supprimer automatiquement les vieux snapshots et ainsi économiser sur le stockage. En résumé, chaque ressource doit justifier sa taille et son existence par une utilisation effective.

2. Autoscaling et élasticité : Exploitez l’autoscaling sur vos groupes d’instances EC2 et vos conteneurs (ECS/EKS) pour adapter dynamiquement la capacité aux besoins réels. Cela évite de payer pour des serveurs inutilisés pendant les périodes creuses. De plus, pensez à utiliser les services managés serverless (AWS Lambda, Fargate…) lorsque c’est pertinent : vous ne payez que à l’exécution, ce qui élimine les coûts d’infrastructure idle. Par exemple, un batch de traitement de données peut être déplacé sur des fonctions Lambda déclenchées à la demande pour ne pas maintenir de machines allumées en continu.

AWS facture cher la flexibilité du on-demand, mais récompense les engagements. Reserved Instances & Savings Plans offrent jusqu’à –72 % sur le tarif horaire en échange d’un engagement 1 ou 3 ans

3. Réserver et engager pour payer moins : AWS facture cher la flexibilité du on-demand, mais récompense les engagements. Reserved Instances & Savings Plans offrent jusqu’à –72 % sur le tarif horaire en échange d’un engagement 1 ou 3 ans. Analysez vos workloads stables (serveurs de base de données, instances applicatives en production) et achetez des réservations pour ceux-ci. AWS Trusted Advisor ou Cost Explorer peuvent recommander des RIs lorsqu’ils détectent des instances tournant en continu sur plusieurs mois. Préférez les Savings Plans si vous cherchez plus de flexibilité (ils s’appliquent automatiquement aux instances éligibles, même si vous changez de type/région dans la même famille). Surveillez le taux d’utilisation de vos réservations – l’objectif est de les utiliser à 100 %. Si ce n’est pas le cas, il peut être judicieux de revendre sur le marketplace AWS les RIs excédentaires ou de modifier un Savings Plan convertible. En optimisant l’achat engagé, des entreprises ont économisé des millions : par exemple, Netflix a largement recours aux Reserved Instances et instances Spot pour ses workloads transcodage, ce qui lui a permis d’absorber une croissance de trafic exponentielle sans explosion de coûts.

4. Exploiter les instances Spot : Les instances Spot AWS sont proposées avec des rabais de 70–90 % par rapport au prix normal, en échange de l’acceptation d’interruptions (AWS peut reprendre l’instance moyennant un préavis court). Pour les tâches flexibles – traitements batch, jobs Big Data, environnements de test/CI – c’est un levier d’économies majeur. Mettez en place des mécanismes de reprise (tâches idempotentes, checkpoints) et profitez-en : de nombreuses entreprises, comme Airbnb ou Pinterest, ont bâti des plateformes de calcul haute capacité à coût réduit en s’appuyant sur du Spot pour les charges non critiques. AWS fournit des outils comme EC2 Fleet ou Spot Advisor pour faciliter l’utilisation des Spots (choix des types d’instances alternatifs, gestion des interruptions). Cette stratégie nécessite un peu d’ingénierie, mais les gains financiers sont très importants sur le long terme.

5. Nettoyage et optimisation continue : L’optimisation AWS n’est pas un effort ponctuel, c’est un processus continu. Instituez des « nettoyage du vendredi » ou audits mensuels de vos ressources AWS : supprimer les instances de test oubliées, les adresses IP Elastic non rattachées, les Load Balancers sans trafic, les anciennes AMI et snapshots, etc. Automatisez autant que possible ce nettoyage avec des scripts ou des fonctions Lambda programmées. Adoptez une politique pour les environnements de développement/staging : par exemple, éteindre toutes les VM de dev la nuit et le week-end (AWS Instance Scheduler peut vous y aider). Chaque ressource dormante éliminée se traduit par des économies directes. Enfin, n’hésitez pas à revoir vos architectures : parfois, remplacer une solution coûteuse par une alternative plus simple peut réduire drastiquement les coûts. Par exemple, une application temps réel utilisant Kinesis (onéreux) a pu passer sur un système de files de messages plus basique et économique sans impact sur le service rendu. De même, préférez les services gérés adaptés (AWS Aurora Serverless, DynamoDB auto-scalé, etc.) qui ajustent automatiquement les ressources et coûts à la demande.

En appliquant ces stratégies sur AWS, beaucoup d’entreprises ont réussi à renverser la tendance. Plutôt que de subir une facture en hausse constante, elles créent une culture de l’optimisation : chaque nouveau déploiement s’accompagne de réflexes de cost control. AWS fournit d’ailleurs un Well-Architected Framework incluant un pilier “Optimisation des coûts” – signe que le coût doit être pensé dès la conception. Avec une gouvernance adéquate, un cloud AWS performant ne doit pas forcément rimer avec dépenses exorbitantes.

Stratégies d’optimisation des coûts sur Azure

Profitez de l’Azure Hybrid Benefit si vous disposez déjà de licences Windows Server ou SQL Server sur site : en les réutilisant dans Azure, vous économisez le coût de licence dans la VM cloud, avec jusqu’à 80 % de réduction possible sur certains workloads Windows en combinant Hybrid Benefit + réservation

Du côté de Microsoft Azure, les leviers d’optimisation des coûts sont similaires dans l’esprit à AWS, avec quelques spécificités liées à l’écosystème Azure. Voici comment réduire vos dépenses Azure tout en maintenant la qualité de service :

1. Choisir la bonne taille et le bon service : Azure propose de nombreuses tailles de VM (Machines Virtuelles) pour chaque famille (Généraliste, Mémoire optimisée, CPU optimisée, etc.). Analysez l’utilisation de vos VM (CPU, RAM, disque, réseau) via Azure Monitor et redimensionnez les instances surdimensionnées. Par exemple, si un VM D4sv3 n’utilise que 10 % de ses CPU, passez peut-être sur un D2sv3 bien moins cher. Azure Advisor fournit des recommandations de “right-sizing” basées sur 7 jours ou 30 jours de métriques – suivez ces conseils pour ajuster vos ressources. De plus, envisagez l’utilisation de services PaaS managés qui peuvent être plus économiques à charge égale. Par exemple, au lieu d’une VM + SQL Server installée, une base de données managée Azure SQL avec échelonnement automatique évitera de payer en continu pour des ressources inutilisées. De même, Azure Functions ou App Services Plan (avec autoscale) peuvent remplacer avantageusement des VM persistantes pour certains workloads web ou batch intermittents. Chaque service Azure a son modèle de coût : assurez-vous d’utiliser la offre la mieux adaptée (par ex. stockage Cool ou Archive pour des données peu accédées afin de payer moins cher le Go).

2. Nettoyer et automatiser l’extinction des ressources inutilisées : Azure fournit des outils natifs pour éviter de laisser tourner des ressources à vide. Servez-vous de la fonctionnalité Auto-shutdown (arrêt automatique) sur vos machines virtuelles de développement/test – vous pouvez planifier l’extinction le soir et le week-end, avec envoi d’un rappel aux utilisateurs. Mettez en place des politiques de nettoyage des ressources orphelines : disques managés non attachés à une VM, adresses IP publiques non utilisées, groupes de ressources vides, etc. Azure Cost Management peut vous signaler certaines anomalies, mais il est souvent nécessaire de scripter ces vérifications (via Azure PowerShell, CLI ou Azure Automation Runbooks). Quelques exemples : supprimer les blobs de stockage obsolètes (et activer des règles de rétention limitant la durée de conservation), vider les files d’attente ou hubs IoT non utilisés, ou encore supprimer les bases de données de test restées en ligne après un projet. En automatisant le cycle de vie, on évite la multiplication de petites dépenses fantômes qui finissent par peser lourd.

3. Exploiter les remises et avantages Azure : Comme AWS, Azure propose des mécanismes de réduction pour usage engagé. Les Azure Reservations permettent de réserver de la capacité (VM, base de données, etc.) sur 1 ou 3 ans avec des remises jusqu’à 72-75 %. Azure a introduit également les Azure Saving Plans pour plus de flexibilité sur les VM (similaire aux Savings Plans AWS). Identifiez les workloads tournant en permanence et achetez des réservations correspondantes (via Azure Cost Management + Billing, qui recommande souvent des réservations avec estimation d’économies). À titre d’exemple, réserver une instance SQL Database standard ou un throughput Cosmos DB peut drastiquement réduire le coût mensuel si la charge est stable. Surveillez là aussi l’utilisation de vos réservations – Azure indique le taux d’utilisation, il faut viser le 100 %. Par ailleurs, profitez de l’Azure Hybrid Benefit si vous disposez déjà de licences Windows Server ou SQL Server sur site : en les réutilisant dans Azure, vous économisez le coût de licence dans la VM cloud, avec jusqu’à 80 % de réduction possible sur certains workloads Windows en combinant Hybrid Benefit + réservation. Ce programme est un atout majeur d’Azure pour les clients Microsoft existants, et peut faire la différence sur la facture des VM Windows/SQL. Enfin, scrutez les offres spéciales Azure (par exemple, des crédits gratuits via des programmes ou des remises pour les environnements de test via les Dev/Test subscriptions).

4. Azure Advisor et gouvernance des coûts : Azure Advisor est un service gratuit qui analyse en continu votre configuration et émet des recommandations d’optimisation sur quatre axes : Coûts, Sécurité, Haute disponibilité et Performance. La section Coûts d’Advisor vous indiquera par exemple quelles VM sont sous-utilisées, si vous pourriez économiser en activant une réservation, ou si des ressources pourraient être arrêtées la nuit. Intégrez ces recommandations dans votre routine : par exemple, un reporting mensuel où chaque équipe examine les conseils d’Advisor liés à ses ressources et planifie les actions (éteindre telle VM de dev, réduire la taille de tel App Service, etc.). Couplé à Azure Cost Management (pour la visibilité budgétaire) et Azure Policy (pour imposer certaines règles, comme empêcher de déployer des VM trop coûteuses sur des abonnements de test), cela forme une solide gouvernance. Microsoft IT a d’ailleurs partagé comment, en interne, les équipes Azure de Microsoft ont réduit leurs coûts cloud en s’appuyant fortement sur Azure Advisor, Cost Management et une gouvernance centralisée : dans l’un des plus gros environnements Azure au monde, ils ont pu servir de blueprint en optimisant chaque recoin et en modernisant les anciens workloads. Inspirez-vous de cette démarche en créant, vous aussi, un cadre FinOps sur Azure où les coûts sont continuellement mesurés et optimisés.

5. Optimisation des bases de données et applications : Sur Azure, ne négligez pas les optimisations au niveau applicatif qui peuvent réduire les besoins en infrastructure. Par exemple, tuner une base de données SQL (ajouter un index bien choisi, optimiser une requête inefficace) peut permettre de descendre d’un palier de service et d’économiser immédiatement. De même, si vous avez migré une application legacy sur des VM Azure, envisagez de la moderniser vers un service PaaS plus efficient. Un cas fréquent : déplacer un ETL tournant sur une VM vers Azure Data Factory ou Azure Synapse Serverless, qui ne facturent qu’à l’exécution et peuvent s’arrêter complètement en dehors des horaires de traitement. Azure propose également des fonctionnalités d’autoscale sur les bases de données (notamment Hyperscale ou les pools élastiques SQL) pour ne pas surprovisionner en permanence. L’optimisation des coûts cloud passe donc aussi par des choix d’architecture logicielle : code plus efficient = moins de ressources consommées. Incitez vos équipes de développement à adopter une culture de l’efficacité (profilage des applis, nettoyage du code inutile, choix de frameworks légers, etc.), car in fine, la meilleure façon d’économiser est de ne pas consommer ce dont on n’a pas besoin.

En combinant ces mesures, les entreprises peuvent grandement réduire leurs dépenses Azure. Il n’est pas rare de voir des cas concrets de baisse de 20-30 % de la facture après une initiative d’optimisation ciblée de quelques mois. L’important est de pérenniser ces gains par une gouvernance continue : revue régulière des coûts par service, responsabilisation des équipes sur leurs budgets cloud, et intégration de l’optimisation dès la phase de design des projets. Azure, tout comme AWS, met à disposition de nombreux outils pour y parvenir – à vous de les exploiter pour faire du cloud un atout agile et rentable.

FinOps et gouvernance : maîtriser les dépenses cloud dans la durée

Une étude a montré que seuls 30 % des organisations peuvent allouer plus des deux-tiers de leurs dépenses cloud avec précision

Au-delà des optimisations purement techniques, l’optimisation des coûts cloud nécessite une approche organisationnelle et culturelle : c’est tout l’esprit du FinOps (Financial Operations). Le FinOps vise à instaurer une gouvernance financière du cloud en brisant les silos entre les équipes techniques, financières et métier. L’idée centrale est de créer une culture de la responsabilité sur les dépenses cloud : chaque équipe, du développement aux opérations, doit comprendre le coût de ce qu’elle consomme et en être comptable. Comme le résume la FinOps Foundation, “Everyone takes ownership for their cloud usage” – tout le monde est responsable de sa consommation, et ce n’est plus seulement un sujet pour la DAF en fin de trimestre.

Concrètement, mettre en place le FinOps, c’est d’abord informer et donner de la visibilité (phase “Inform”). Cela passe par des tableaux de bord de coût accessibles en libre-service, des rapports réguliers par produit/projet, et une répartition claire des dépenses via le tagging et les centres de coûts. Par exemple, établir que l’équipe X a dépensé Y euros sur Azure ce mois-ci pour livrer telle fonctionnalité. Cette transparence crée un électrochoc positif : on constate souvent une réduction spontanée de gaspillage dès lors que les équipes voient et comprennent leur facture. Une étude a montré que seuls 30 % des organisations peuvent allouer plus des deux-tiers de leurs dépenses cloud avec précision, d’où l’importance de travailler ce point (via des outils de répartition et d’allocations, voir section suivante).

Une statistique marquante révélée par une enquête Wakefield Research indique que 89 % des professionnels IT estiment que le FinOps est “le moyen de dompter la complexité des coûts cloud”

Ensuite vient la phase Optimiser : FinOps encourage l’action continue pour réduire les coûts inutiles (arrêter des ressources, ajuster les réservations, éliminer le surprovisionnement). Il s’agit de transformer les données en décisions concrètes, idéalement en temps quasi réel plutôt qu’une fois par an. D’où la nécessité d’outils d’alertes, d’anomalie, et de rituels fréquents (par exemple, des “FinOps days” mensuels où l’on passe en revue les principaux postes de dépenses et les opportunités d’économies). Les équipes doivent se poser la question : “Cette dépense cloud apporte-t-elle de la valeur business proportionnée ?”. Sinon, on l’optimise ou on la coupe. Une statistique marquante révélée par une enquête Wakefield Research indique que 89 % des professionnels IT estiment que le FinOps est “le moyen de dompter la complexité des coûts cloud”. Autrement dit, face à la jungle tarifaire, la démarche FinOps outillée est perçue comme la solution pour optimiser sans sacrifier l’innovation.

Le troisième pilier est l’Opération (ou Run) continue. Le FinOps n’est pas un projet ponctuel mais un processus itératif inscrit dans la durée. « FinOps n’est pas un exercice annuel unique, c’est un effort perpétuel », souligne Fredy Cheung (NetApp). Il faut intégrer l’optimisation des coûts dans le cycle de vie de vos applications : à chaque nouvelle architecture cloud, valider qu’elle respecte les bonnes pratiques coût (d’où l’importance des well-architected reviews, qui incluent un volet coût). Surveiller en continu les métriques de coût par produit (€/transaction, €/utilisateur actif, etc.) est un excellent moyen de lier la dépense à la valeur délivrée. Par exemple, si le coût par utilisateur dépasse le revenu par utilisateur, c’est un signal d’alerte pour ajuster le tir. Certaines entreprises calculent ainsi le coût de revient cloud par fonctionnalité ou par client (on parle d’Unit Economics du cloud) afin de guider les décisions – c’est une pratique émergente poussée par la FinOps Foundation pour aller au-delà de la simple réduction de coûts, et optimiser le ROI du cloud pour chaque unité de valeur produite.

Pour réussir, le FinOps doit s’appuyer sur quelques principes clés. La FinOps Foundation en a défini six : collaboration inter-équipes, responsabilisation générale, équipe FinOps centrale facilitatrice, reporting accessible en temps voulu, décisions basées sur la valeur business, et exploitation du modèle de coûts variables du cloud. Ces principes peuvent servir de charte interne. Par exemple, décisions basées sur la valeur signifie qu’on ne cherche pas à réduire les coûts pour le principe, mais à maximiser le rapport valeur/coût – parfois dépenser plus dans un service cloud donné peut être justifié s’il apporte une forte valeur ajoutée (meilleure performance utilisateur conduisant à plus de revenus, etc.). Le FinOps vise l’efficience plutôt que la seule frugalité extrême.

Un autre aspect important de la gouvernance FinOps est la mise en place d’objectifs et KPIs partagés. Cela peut inclure : pour les équipes tech, un indicateur de coût par déploiement ou par fonctionnalité ; pour les produits, un suivi de la marge opérationnelle cloud ; pour la DSI, un taux d’adoption des recommandations d’optimisation. Certaines organisations intègrent les coûts dans les Scorecards d’équipes ou dans les OKR trimestriels (par ex. “réduire de 15 % le coût par requête de notre API d’ici la fin du trimestre”). Ce type d’objectifs incite à l’action et confère du poids stratégique à la démarche. D’après un rapport du FinOps Foundation, 73 % des dirigeants déclarent que les coûts cloud sont désormais discutés jusqu’au niveau du Comex/Board – signe que le sujet est devenu assez stratégique pour faire l’objet de KPIs à haut niveau.

Enfin, le FinOps implique de former et sensibiliser. Il peut être utile d’organiser des sessions de formation pour les développeurs et architectes sur la compréhension des coûts cloud (comment est calculé le coût d’une Lambda AWS ou d’une VM Azure, quelles sont les bonnes pratiques d’optimisation, etc.). Le but est que chacun acquière le réflexe coût. Par exemple, chez Netflix, les ingénieurs disposent d’un outil interne (accessible via l’IDE) pour estimer le coût de leur code avant déploiement – ce genre d’initiative relève de FinOps, en amenant la conscience des coûts en amont du cycle de vie.

En résumé, FinOps et gouvernance financière du cloud permettent de pérenniser les économies. Là où une simple campagne de réduction de coûts pourrait n’avoir qu’un effet temporaire, la culture FinOps ancre une discipline continue. Les entreprises les plus matures en la matière (souvent classées “FinOps en mode Run”) monitorent chaque jour leurs dépenses, les rapprochent des bénéfices générés, et ajustent en temps réel leurs ressources. C’est un avantage concurrentiel : “FinOps crée un modèle financier cloud qui maximise le ROI tout en assurant performance et disponibilité”, pour citer un responsable IT ayant conduit cette transformation. Et les chiffres confirment l’importance de la démarche : 96 % des organisations considèrent le FinOps comme crucial pour le succès de leur stratégie cloud… mais seulement ~10 % estiment avoir une pratique FinOps pleinement mature à ce jour. Il y a donc une marge de progression énorme – et ceux qui l’exploitent en premier en retirent un avantage financier certain.

Outils et services pour la gestion des coûts cloud

Pour soutenir ces efforts d’optimisation et de gouvernance, il existe un large éventail d’outils FinOps et de services de gestion des coûts cloud. Ils se répartissent en deux catégories : les solutions natives offertes par AWS, Azure (et les autres clouds), et les plateformes tierces ou open-source spécialisées dans le pilotage financier du cloud.

Côté outils natifs, chaque fournisseur cloud propose un panel d’outils gratuits pour suivre et contrôler les dépenses. Sur AWS, on retrouve notamment : Billing Console et Cost Explorer (visualisation interactive des coûts par service, avec filtrage par tags, prévisions de dépenses…), AWS Budgets (alertes configurables sur dépassement de seuil ou forecast mensuel, pouvant même déclencher des actions automatiques), Cost Anomaly Detection (surveillance des anomalies de coût jour par jour), et AWS Trusted Advisor / Compute Optimizer (recommandations d’optimisation telles que “vous pouvez économiser X% en passant cette instance en taille inférieure” ou en achetant une RI). AWS propose aussi le AWS Billing Conductor pour refacturer en interne par business units, et des outils de gouvernance multi-comptes comme AWS Organizations avec des Service Control Policies pouvant limiter l’usage de services coûteux sur certaines OU (par exemple interdire de lancer des instances GPU onéreuses sur le compte Dev). Azure de son côté fournit Azure Cost Management + Billing, un hub central pour analyser les coûts Azure et même AWS/GCP (Azure Cost Management – acquis via Cloudyn – peut agréger des coûts multi-cloud). On y configure des budgets Azure (avec alertes par mail ou Action Groups), on y consulte les tendances de dépenses et on peut exploiter les Cost Analysis par ressource ou ressource group. Azure Advisor a été évoqué plus tôt pour ses recommandations, et Azure Policy peut servir à imposer, par exemple, un tag “Owner” sur chaque ressource (sinon déploiement refusé) afin de ne rien laisser d’inventorié. Sur Google Cloud, citons Google Cloud Billing Reports et Recommender (similaire à Advisor), ainsi que Billing Alerts. Tous ces outils natifs sont précieux : ils offrent des tableaux de bord de base, intégrés à la console cloud, et souvent des APIs pour automatiser la récupération d’infos (ex : exporter le AWS Cost and Usage Report quotidien vers un bucket S3 puis l’analyser via Athena). Leur limite peut être qu’ils fonctionnent silo par silo (chaque cloud séparé) et qu’ils nécessitent parfois du traitement manuel pour en tirer des insights actionnables. Néanmoins, aucune initiative FinOps ne devrait faire l’impasse sur ces fondations natives, qui fournissent les données brutes essentielles.

Viennent ensuite les plateformes tierces de Cloud Cost Management / FinOps. Ces outils – souvent proposés par des éditeurs spécialisés ou des startups innovantes – offrent une couche d’intelligence et d’automatisation supplémentaire par-dessus les données natives. Leur promesse : une vue unifiée multi-cloud, des analyses avancées et des actions automatiques pour optimiser en continu. Parmi les solutions bien établies figurent par exemple CloudHealth by VMware (longtemps leader sur la gestion multi-cloud, offrant des fonctionnalités de réallocation de coûts, de droitsizing automatisé et de governance policies), Apptio Cloudability (pionnier du FinOps, très utilisé par les grandes entreprises pour la répartition fine des coûts et les tableaux de bord exécutifs), ou Flexera One (intégré à une suite plus large de gestion d’actifs, incluant le suivi des coûts cloud). Des acteurs plus récents et très innovants ont émergé : CloudZero, Finout, Cast.ai, DoiT, Spot by NetApp, Ternary, Economize, etc., chacun apportant sa touche. Par exemple, Finout se distingue en agrégeant non seulement les coûts cloud mais aussi SaaS, pour donner une vision complète des dépenses IT d’une entreprise. Spot (NetApp) automatise l’achat/revente de instances Spot et réservations pour optimiser en temps réel. Cast.ai se focalise sur l’optimisation des clusters Kubernetes (droitsizing des pods, scheduling intelligent sur des instances Spot). Ternary offre un portail collaboratif FinOps où ingénieurs et financiers peuvent dialoguer autour de rapports de coût partagés. Le choix de la plateforme dépend de vos besoins : certaines mettent l’accent sur la visualisation et l’allocation (dashboarding, showback/chargeback avec conversion en coûts par produit), d’autres sur l’optimisation proactive (moteurs de recommandations s’exécutant et corrigeant automatiquement les dérives). Il est important d’évaluer des critères comme la multi-compatibilité cloud (par ex, bien vérifier qu’un outil supporte AWS et Azure si vous êtes multi-cloud), les capacités d’intégration (API, connecteurs vers Jira, ServiceNow pour créer des tickets d’optimisation, etc.), et bien sûr le ROI de l’outil lui-même. Sur ce dernier point, beaucoup de ces solutions se financent en prélevant un pourcentage des économies réalisées ou du budget cloud géré – leur intérêt étant donc aligné avec le vôtre (réduire la dépense inutile).

En complément, l’écosystème open-source FinOps se développe également. Par exemple, Infracost est un outil ouvert très populaire qui s’intègre à Terraform ou CI/CD pour estimer le coût d’une infrastructure avant déploiement (pratique pour éviter de lancer par inadvertance des ressources ruineuses). OpenCost fournit une visibilité coût en temps réel sur Kubernetes (notamment sur les clusters multi-tenant, en calculant la part de coût par namespace/étiquette). On trouve aussi OptScale (Hystax), une plateforme FinOps open-source capable d’auditer et d’optimiser les environnements cloud avec des policies personalisées. Ces solutions libres ont l’avantage de la transparence et de la communauté, mais requièrent souvent un peu plus d’effort d’installation et de maintenance. Néanmoins, pour une organisation technique, adopter et contribuer à un outil open-source FinOps peut être un excellent moyen de diffuser la culture coûts auprès des équipes, tout en évitant une dépendance à un fournisseur.

Intégration aux processus existants : un aspect souvent sous-estimé est l’intégration des outils de cost management dans vos workflows. Idéalement, les développeurs devraient pouvoir consulter l’impact budgétaire de leurs choix sans friction. On peut intégrer des cost alerts dans Teams/Slack (ex : via l’API AWS Budgets ou Azure Alerts), mettre en place un chatbot FinOps qui répond aux questions “Combien avons-nous dépensé sur tel service cette semaine ?”, ou brancher les outils FinOps aux pipelines CI/CD. Par exemple, lorsqu’une pull request est ouverte, Infracost peut commenter automatiquement le coût estimé des ressources Terraform ajoutées – cela sensibilise les développeurs en amont. De même, connecter des outils comme Cloud Custodian (moteur de règles policy-as-code) permet d’appliquer automatiquement des règles de nettoyage ou de tag au fil de l’eau, sans intervention humaine systématique. Le FinOps bien outillé, c’est un FinOps en grande partie automatisé : on vise des “guardrails” plutôt que des actions manuelles chronophages. Par exemple, si un développeur déploie par mégarde une base de données en SKU très onéreux, une policy pourrait la stopper immédiatement et notifier l’équipe. Ou si un budget mensuel d’équipe atteint 90 %, un webhook pourrait créer automatiquement un ticket Jira demandant une revue d’usage.

Enfin, n’oublions pas la dimension reporting et communication. Les outils doivent aussi servir à présenter les succès de l’optimisation. Un dashboard montrant que “l’équipe A a réduit son coût par utilisateur de 15 % ce trimestre” ou que “l’initiative X a permis d’éviter Y euros de dépenses” aide à maintenir l’adhésion et la motivation des troupes. De plus, beaucoup de directions ont désormais besoin de rapports consolidés multi-cloud : des outils comme CloudHealth ou Cloudability excellent dans ce rôle, en produisant par exemple un Executive Report mensuel avec les tendances clés, les top 5 services par coût, les prévisions, etc. Cette professionnalisation du reporting cloud contribue à faire reconnaître en interne le FinOps comme une véritable pratique à valeur ajoutée, et non comme de la simple optimisation budgétaire ponctuelle.

En synthèse, il existe aujourd’hui un vaste arsenal d’outils pour maîtriser les coûts du cloud. L’important est de bien les choisir et de les intégrer à votre organisation. Commencez par exploiter à fond les capacités natives gratuites (que beaucoup sous-utilisent), puis évaluez l’intérêt d’une plateforme dédiée si vos dépenses sont significatives ou si vous êtes multi-cloud. Dans tous les cas, ces outils ne sont efficaces qu’accompagnés par une volonté humaine : ils sont là pour faciliter la prise de décision, mais c’est à vos équipes de jouer le jeu de la sobriété et de la responsabilité. Avec les bons outils, “every engineer becomes a cost engineer” – chaque membre de l’équipe peut agir en connaissance de cause sur ses dépenses, et le cloud devient alors un terrain d’innovation maîtrisée, plutôt qu’une boîte noire aux coûts imprévisibles.

Conclusion : vers un cloud performant et rentable

Maîtriser les coûts cloud n’est pas incompatible avec l’agilité et l’innovation – au contraire, c’en est le complément indispensable pour pérenniser une stratégie cloud rentable. En combinant les optimisations techniques (droitsizing, autoscaling, réservations, refonte d’architectures) et une gouvernance FinOps impliquant l’ensemble des parties prenantes, les organisations peuvent transformer leur manière de consommer le cloud. Les bénéfices sont multiples : réduction des dépenses inutiles (et donc amélioration immédiate de la marge), réallocation des budgets vers des projets à plus forte valeur ajoutée, meilleure prévisibilité financière, et même un impact environnemental positif (un cloud optimisé consomme moins d’énergie, rejoignant ainsi les objectifs de green IT).

Cette démarche d’optimisation continue pousse également à exploiter au mieux les atouts du cloud. En optimisant, on découvre souvent de nouveaux services managés plus efficients, on automatise davantage – en somme, on monte en maturité cloud. L’entreprise gagne en compétitivité : elle peut faire plus avec moins, allouer ses ressources financières de façon stratégique, et éviter les mauvaises surprises. Surtout, elle développe une culture de la performance où chaque équipe se sent investie dans le résultat opérationnel, coût compris. C’est un cercle vertueux : plus de collaboration entre tech et finance, plus d’innovation responsable, et in fine une création de valeur accrue.

En adoptant dès aujourd’hui une approche structurée d’optimisation des coûts cloud, vous envoyez un message fort : le cloud doit être un catalyseur de croissance, et non un centre de coûts subi. Armé des bonnes pratiques et outils évoqués, chaque responsable IT ou métier peut reprendre le contrôle de sa facture cloud. Certes, le voyage FinOps est un parcours continu – crawl, walk, run – mais les gains se font sentir à chaque étape. L’important est de commencer, d’expérimenter, et d’ancrer les réflexes dans la durée.

En conclusion, l’optimisation des coûts cloud offre un formidable levier pour aligner la DSI sur les objectifs business. Un cloud bien gouverné finance l’innovation plutôt qu’il ne la freine. Réduire les dépenses AWS et Azure, c’est possible sans compromettre la performance ni la fiabilité, en étant malin et discipliné. À vous de jouer : formez vos équipes, outillez-vous intelligemment, et engagez dès maintenant cette démarche proactive. Vos prochains rapports budgétaires montreront des chiffres en baisse là où ça ne crée pas de valeur, et en hausse là où chaque euro investi propulse votre avantage concurrentiel. Un cloud performant et maîtrisé est à portée de main – il commence par une prise de conscience et se concrétise par une action continue.

Prêt à faire passer votre gestion des coûts cloud au niveau supérieur ? Adoptez ces stratégies dès maintenant et inscrivez votre entreprise dans une trajectoire de croissance cloud durable. Pour aller plus loin, n’hésitez pas à vous tenir informé des dernières pratiques FinOps ou à solliciter nos experts – la maîtrise du cloud est un voyage, mais vous n’avez jamais été aussi bien outillé pour en récolter les fruits.

Contactez-nous pour plus d’information.